人类的感官系统非常善于识别我们看到的物体或听到的单词,即使物体是倒置的,或者这个词是用我们从未听说过的声音说的

被称为深度神经网络的计算模型可以被训练来做同样的事情,无论狗的皮毛是什么颜色,都可以正确识别狗的图像,或者无论说话者的音高如何,都可以准确识别单词。然而,麻省理工学院神经科学家的一项新研究发现,这些模型对与目标不相似的图像或单词的反应通常也是一样的

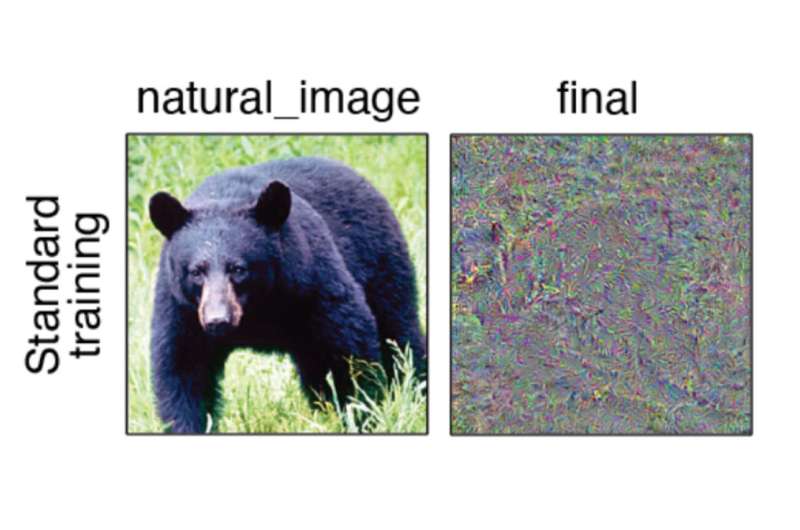

当这些神经网络被用来生成图像或单词时,它们的反应方式与特定的自然输入相同,例如熊的照片,它们中的大多数都生成了人类观察者无法识别的图像或声音。这表明,这些模型建立了自己独特的“不变量”——这意味着它们对具有非常不同特征的刺激的反应方式相同

该研究的高级作者McDermott说:“这篇论文表明,你可以使用这些模型来导出不自然的信号,这些信号最终会对模型中的表示进行非常诊断。”。“这项测试应该成为我们作为一个领域用来评估模型的一系列测试的一部分。”22岁的Jennelle Feather博士现在是熨斗研究所计算神经科学中心的研究员,是这篇发表在《自然神经科学》上的开放获取论文的主要作者。麻省理工学院研究生Guillaume Leclerc和麻省理工大学Cadence设计系统计算教授Aleksander Mådry也是这篇论文的作者。不同的感知

近年来,研究人员训练了深度神经网络,该网络可以分析数百万个输入(声音或图像),并学习共同的特征,使他们能够像人类一样大致准确地对目标单词或对象进行分类。这些模型目前被视为生物感觉系统的领先模型

人们认为,当人类感官系统进行这种分类时,它会学会忽略与物体的核心身份无关的特征,例如有多少光照射在物体上或从什么角度观察物体。这被称为不变性,意味着即使物体在那些不太重要的特征上表现出差异,它们也会被感知为相同的

Feather说:“传统上,我们对感觉系统的思考方式是,它们对同一事物的不同例子可能具有的所有变化源建立不变量。”。“生物体必须认识到它们是同一个东西,即使它们表现为非常不同的感觉信号。”

研究人员想知道,经过训练来执行分类任务的深度神经网络是否会发展出类似的不变量。为了回答这个问题,他们使用这些模型生成刺激,这些刺激在模型内产生与研究人员给模型的示例刺激相同的反应

他们将这些刺激称为“模型元模型”,复兴了经典感知研究中的一种观点,即系统无法区分的刺激可以用于诊断其不变量。超材料的概念最初是在人类感知研究中发展起来的,用来描述看起来相同的颜色,即使它们由不同波长的光组成

令他们惊讶的是,研究人员发现,以这种方式产生的大多数图像和声音看起来和听起来都与模型最初给出的例子完全不同。大多数图像都是一堆看起来随意的像素,声音就像难以理解的噪音。当研究人员向人类观察者展示这些图像时,在大多数情况下,人类并没有将模型合成的图像分类为与原始目标示例相同的类别

Feather说:“它们真的根本无法被人类识别。它们看起来或听起来都不自然,也没有人可以用来对物体或单词进行分类的可解释特征。”

研究结果表明,这些模型在某种程度上发展了自己的不变量,与人类感知系统中发现的不变量不同。这导致模型将成对的刺激感知为相同的,尽管它们与人类截然不同。独特不变量

研究人员在许多不同的视觉和听觉模型中发现了相同的效果。然而,这些模型中的每一个似乎都发展出了自己独特的不变量。当一个模型的元模型被展示给另一个模型时,第二个模型和人类观察者一样无法识别元模型。

麦克德莫特说:“从中得出的关键推论是,这些模型似乎具有我们所说的特质不变量。”。“他们已经学会了在刺激空间中对这些特定维度保持不变,而且这是特定于模型的,所以其他模型没有相同的不变量。”

研究人员还发现,他们可以通过使用一种称为对抗性训练的方法,诱导模型的元模型更容易被人类识别。这种方法最初是为了克服对象识别模型的另一个局限性而开发的,即对图像引入微小的、几乎无法察觉的变化会导致模型对其进行错误识别。

研究人员发现,对抗性训练包括在训练数据中包括一些稍微改变的图像,产生的模型的元模型更容易被人类识别,尽管它们仍然不如原始刺激那么容易识别。研究人员表示,这种改进似乎与训练对模型抵抗对抗性攻击能力的影响无关。

Feather说:“这种特殊形式的训练有很大的效果,但我们真的不知道为什么会有这种效果。”。“这是未来研究的一个领域。”

研究人员表示,分析计算模型产生的元模型可能是一种有用的工具,有助于评估计算模型与人类感官感知系统的基本组织的模仿程度。

Feather说:“这是一个行为测试,你可以在给定的模型上运行,看看模型和人类观察者之间是否共享不变量。”。“它还可以用来评估给定模型中不变量的特殊性,这有助于揭示未来改进我们模型的潜在方法。”