模拟人类听觉系统结构和功能的计算模型可以帮助研究人员设计更好的助听器、耳蜗植入物和脑机接口。麻省理工学院的一项新研究发现,源自机器学习的现代计算模型正朝着这个目标迈进

麻省理工学院的团队在对经过训练以执行听觉任务的深度神经网络进行的迄今为止最大规模的研究中表明,这些模型中的大多数都会生成内部表征,这些表征与人们在听相同声音时在人脑中看到的表征具有相同的特性

这项研究还深入了解了如何最好地训练这种类型的模型:研究人员发现,根据包括背景噪声在内的听觉输入训练的模型更接近于模仿人类听觉皮层的激活模式

“这项研究的与众不同之处在于,它是迄今为止对这类模型与听觉系统进行的最全面的比较。这项研究表明,机器学习产生的模型是朝着正确方向迈出的一步,它为我们提供了一些线索,让我们知道是什么使它们成为更好的大脑模型,”Josh McDermott说,麻省理工学院大脑与认知科学副教授,麻省理工麦戈文大脑研究所和大脑、心智和机器中心成员,该研究的资深作者

麻省理工学院研究生Greta Tucket和Jennelle Feather博士是这篇开放获取论文的主要作者,该论文今天发表在《公共科学图书馆生物学》上

听力模型

深度神经网络是由多层信息处理单元组成的计算模型,这些信息处理单元可以在大量数据上进行训练以执行特定任务。这种类型的模型已被广泛应用于许多应用中,神经科学家已开始探索这些系统也可用于描述人脑如何执行某些任务的可能性

Tucket说:“这些用机器学习构建的模型能够在以前类型的模型所不可能的范围内调节行为,这引起了人们对模型中的表示是否可以捕捉大脑中正在发生的事情的兴趣。”

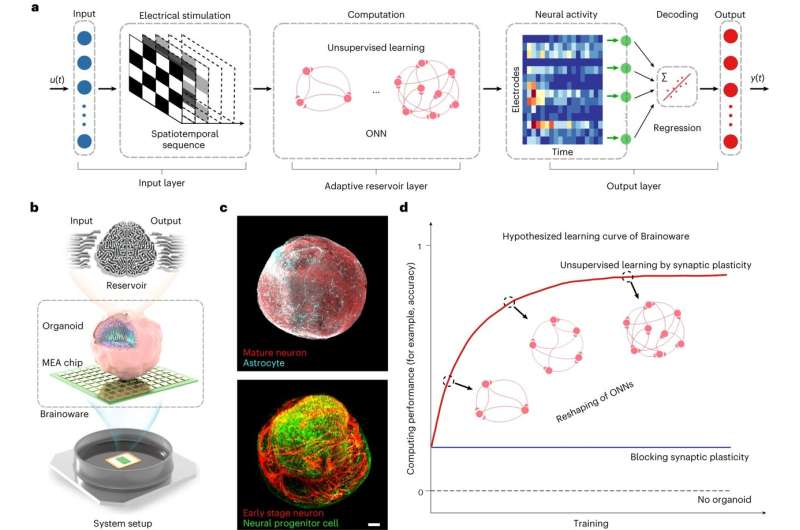

当神经网络执行任务时,其处理单元会根据接收到的每个音频输入(如单词或其他类型的声音)生成激活模式。这些输入的模型表示可以与在听同一输入的人的fMRI大脑扫描中看到的激活模式进行比较

2018年,McDermott和当时的研究生Alexander Kell报告称,当他们训练神经网络执行听觉任务(如从音频信号中识别单词)时,该模型生成的内部表示与听相同声音的人的功能磁共振成像扫描中所见的相似

从那时起,这些类型的模型已经被广泛使用,因此麦克德莫特的研究小组开始评估一组更大的模型,看看这些模型是否具有近似人脑中神经表征的能力

在这项研究中,研究人员分析了九个公开可用的深度神经网络模型,这些模型经过训练可以执行听觉任务,他们还基于两种不同的架构创建了14个自己的模型。这些模型中的大多数被训练来执行一项任务——识别单词、识别说话者、识别环境声音和识别音乐流派——而其中两个被训练来完成多项任务

当研究人员将人类功能磁共振成像实验中用作刺激的自然声音呈现给这些模型时,他们发现内部模型的表现往往与人脑产生的表现相似。其表现与大脑中看到的最相似的模型是在多个任务上训练过的模型,并且在包括背景噪声的听觉输入上训练过

Feather说:“如果你在噪声中训练模型,它们会比不训练模型提供更好的大脑预测,这在直觉上是合理的,因为现实世界中的许多听力都涉及到噪声中的听力,而这似乎是听觉系统所适应的。”

分层处理

这项新研究还支持这样一种观点,即人类听觉皮层具有一定程度的分层组织,其中处理被划分为支持不同计算功能的阶段。与2018年的研究一样,研究人员发现,模型早期生成的表征与初级听觉皮层中的表征最为相似,而模型后期生成的表征则与初级皮层以外的大脑区域中生成的表征更为相似

此外,研究人员发现,受过不同任务训练的模型更善于复制听觉的不同方面。例如,在语音相关任务中训练的模型与语音选择区域更相似

Tucket说:“尽管该模型看到了完全相同的训练数据,架构也相同,但当你为一项特定任务进行优化时,你可以看到它选择性地解释了大脑中的特定调谐特性。”

McDermott的实验室现在计划利用他们的发现,尝试开发更成功地再现人脑反应的模型。除了帮助科学家更多地了解大脑是如何组织的,这些模型还可以用于帮助开发更好的助听器、耳蜗植入物和脑机接口

“我们领域的一个目标是最终开发出一个可以预测大脑反应和行为的计算机模型。我们认为,如果我们成功了

这项研究由美国国立卫生研究院、科学中心的亚马逊奖学金、美国大学妇女协会的国际博士奖学金、麻省理工学院麦戈文之友研究所奖学金和能源部计算科学研究生奖学金资助。